Paper Review. A Neural Attention Model for Abstractive Sentence Summarization@EMNLP' 2015

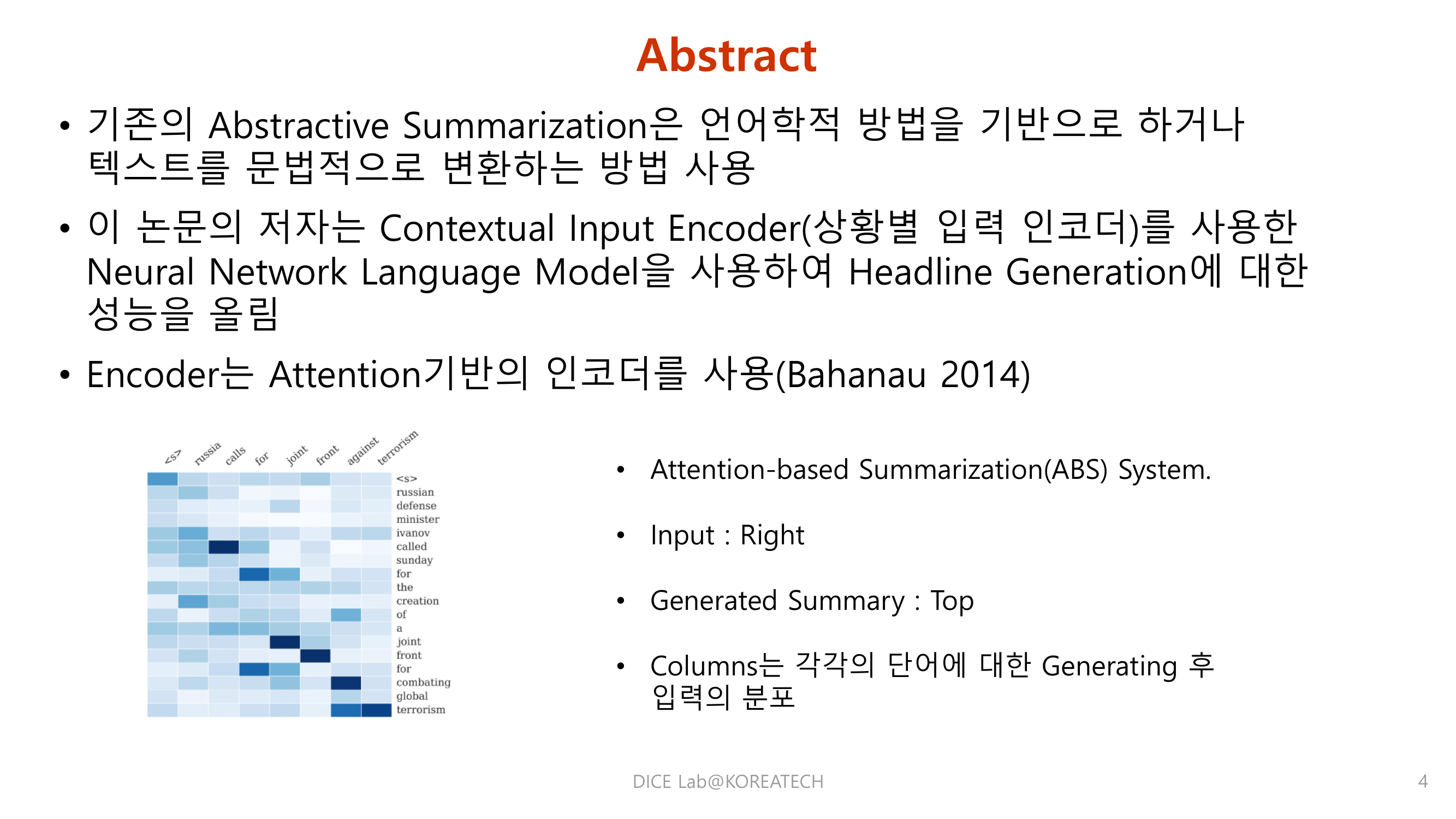

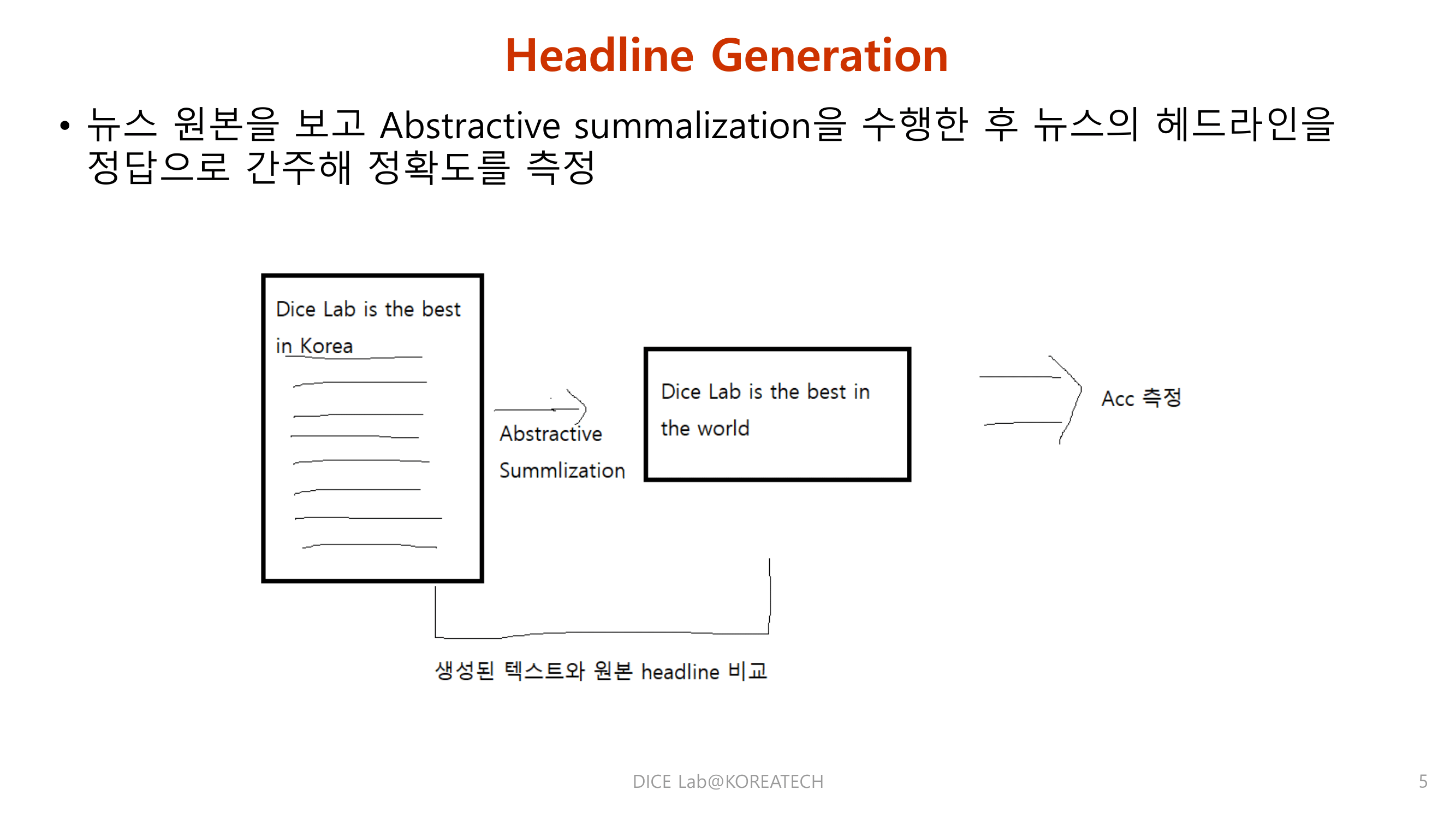

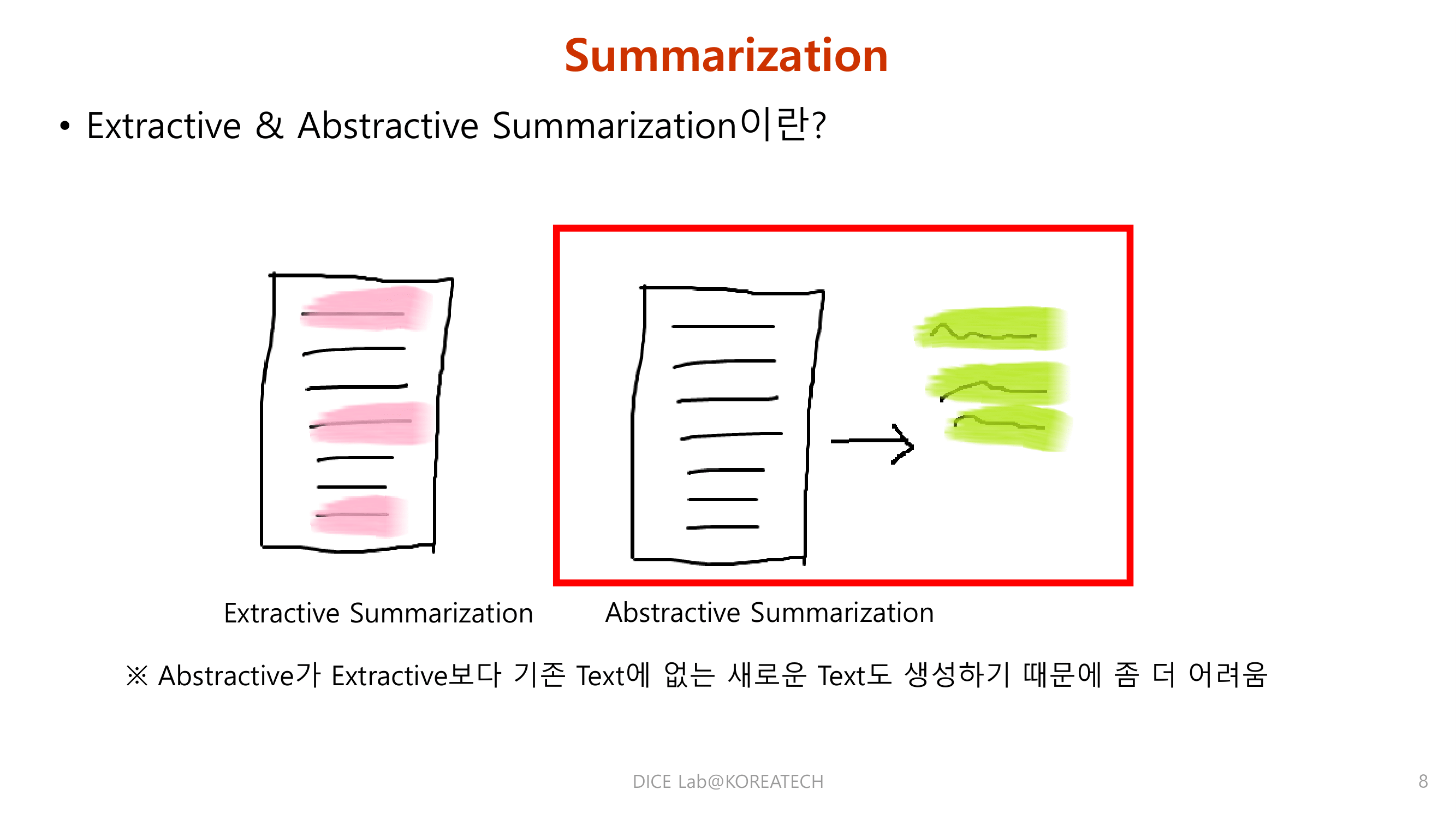

Abstract

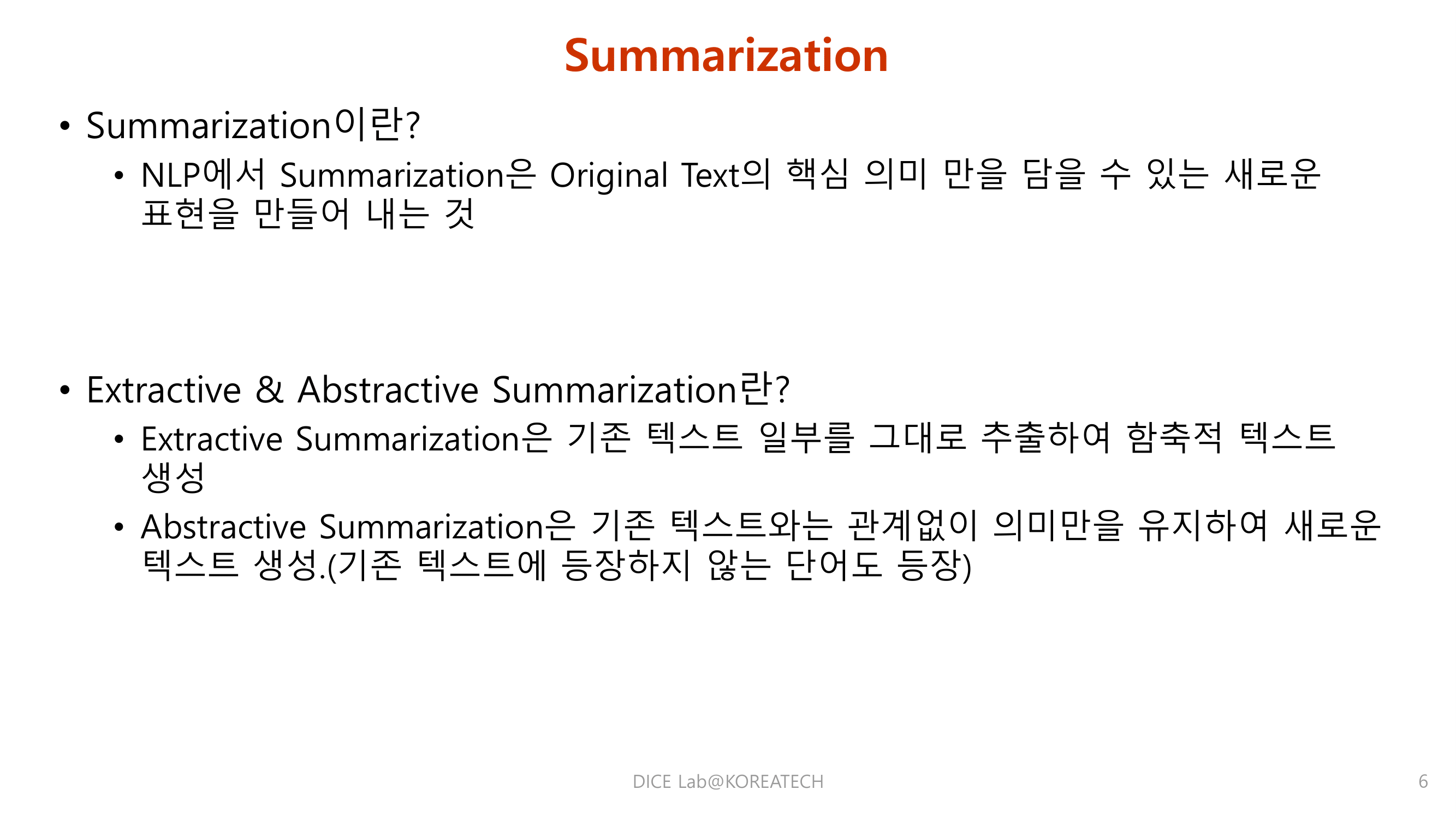

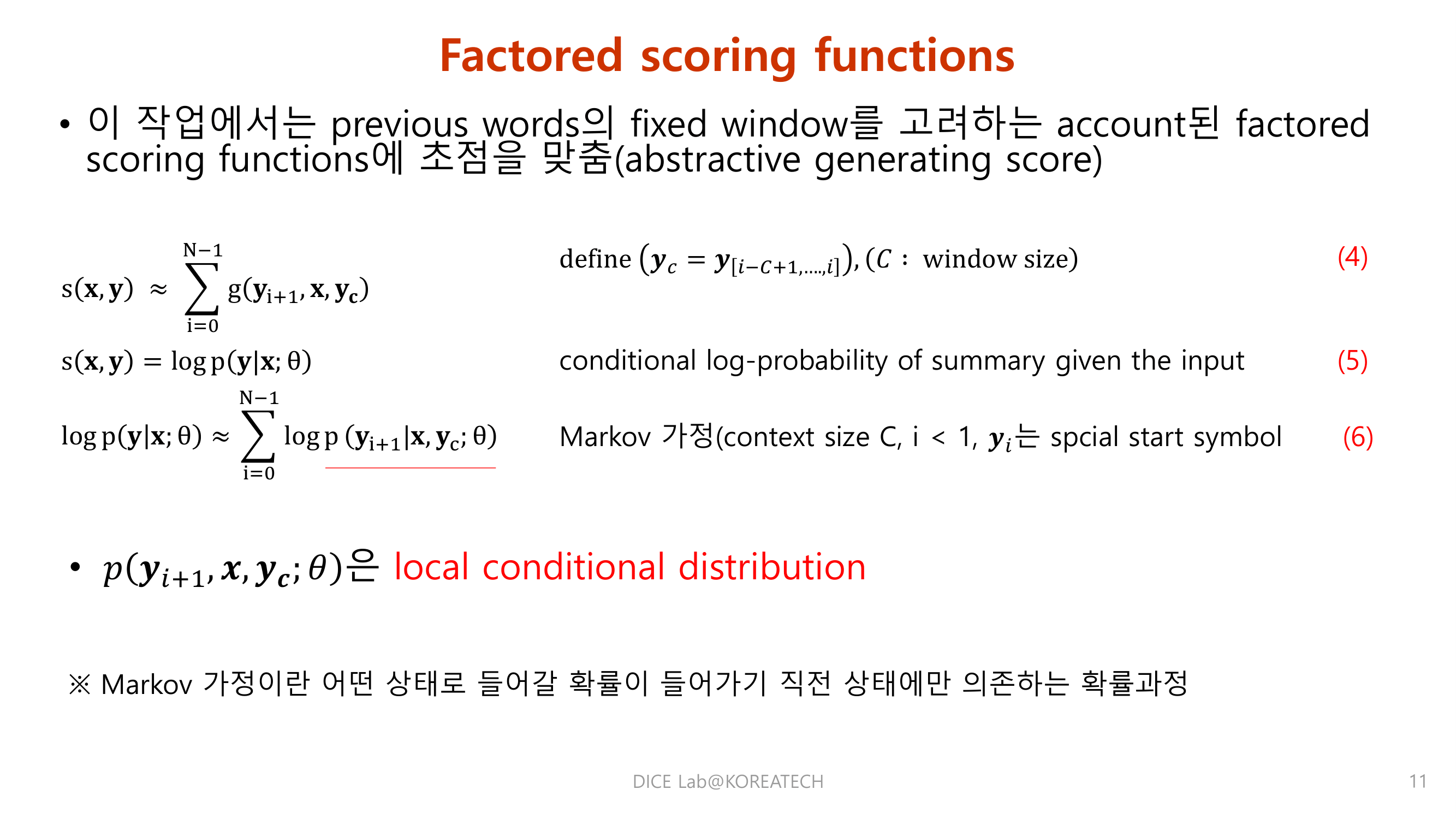

Background

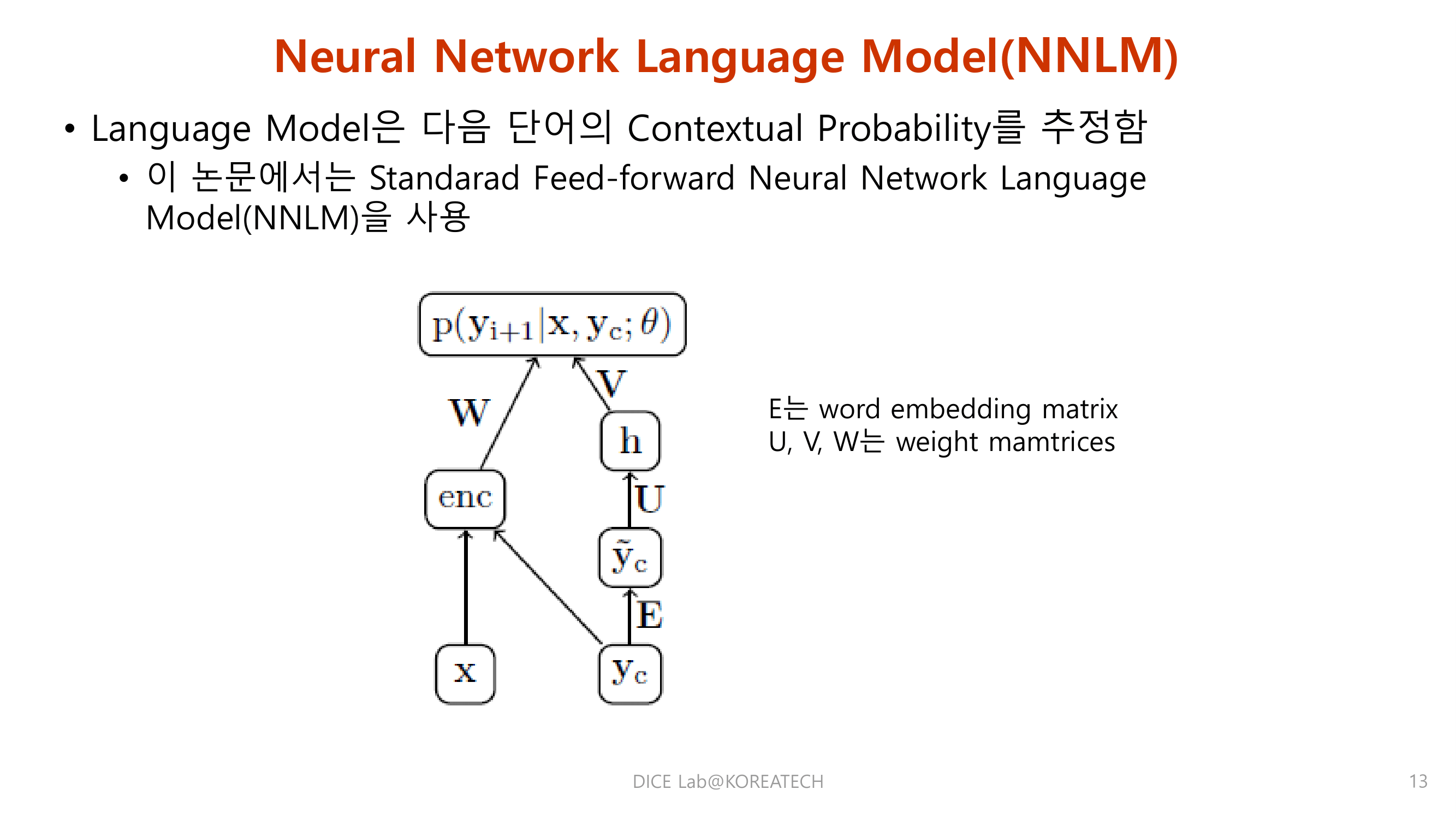

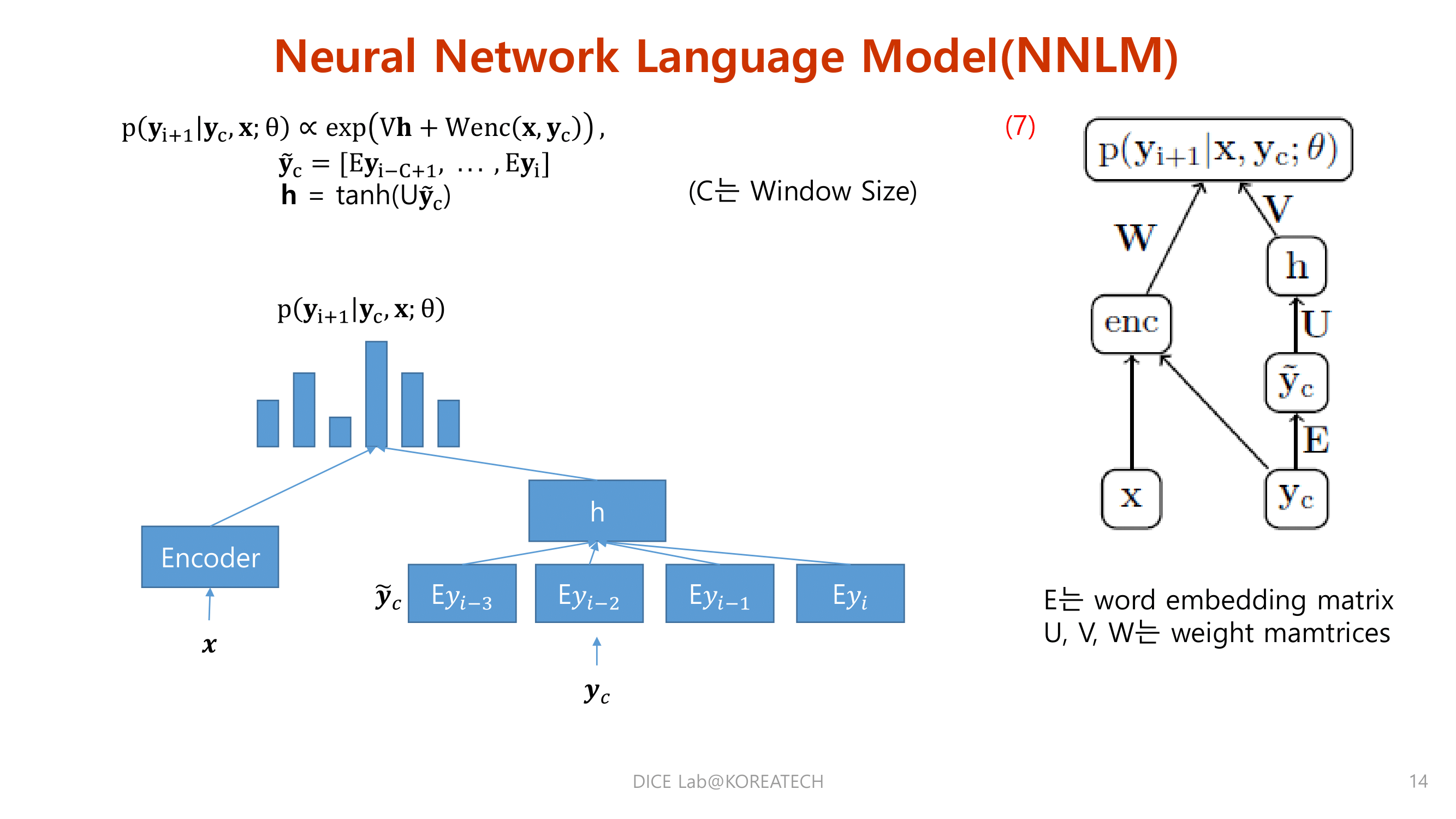

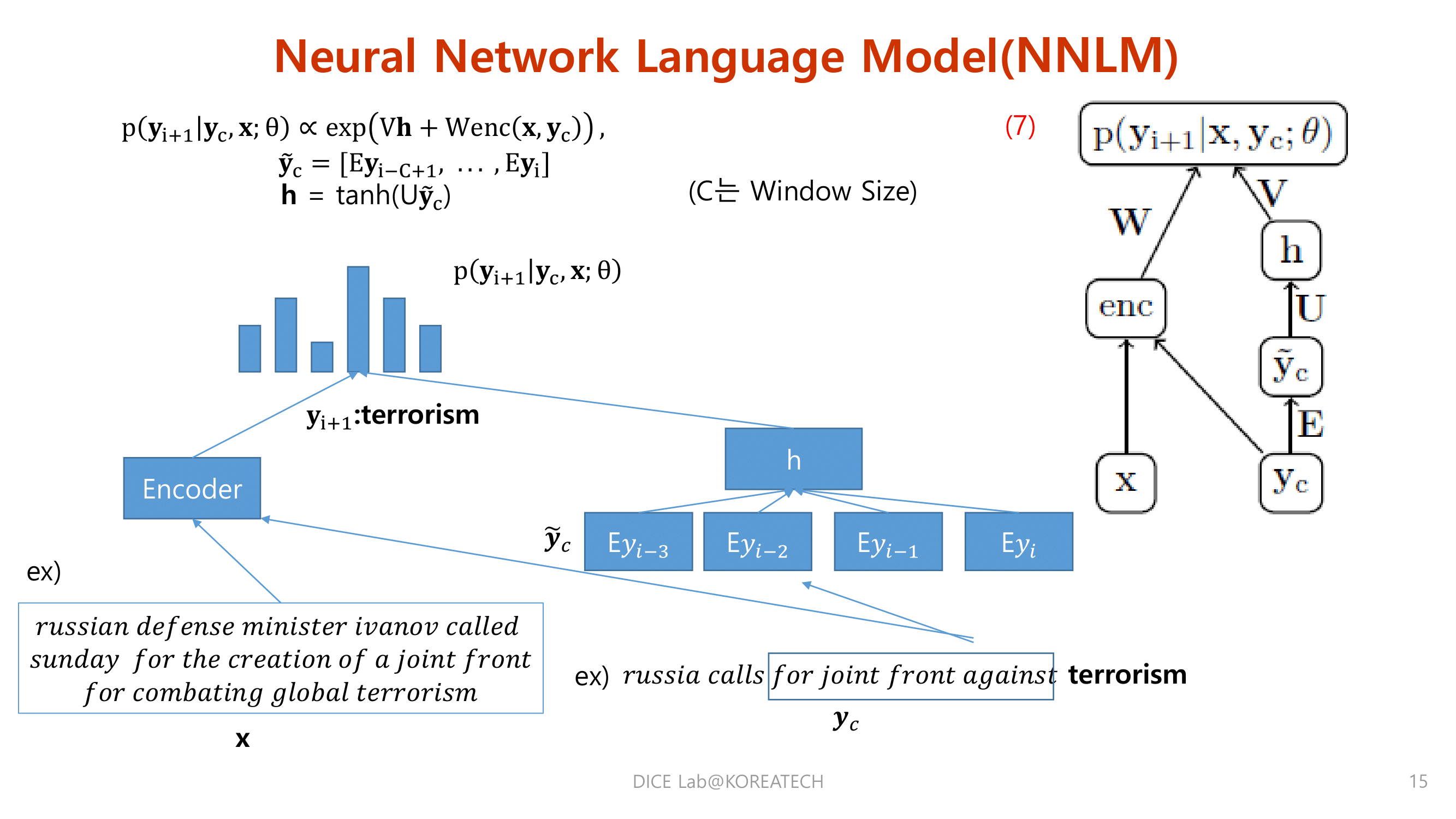

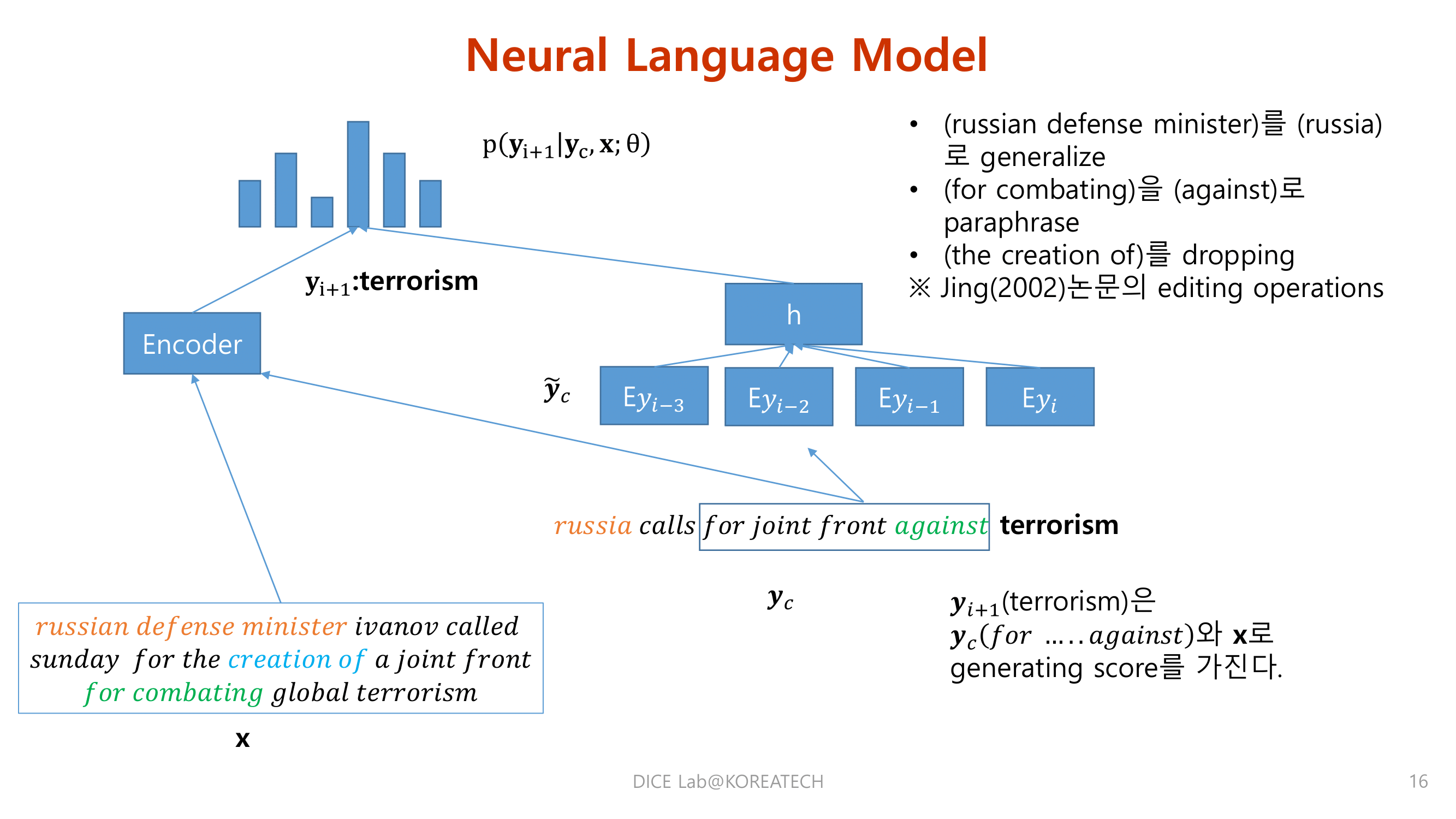

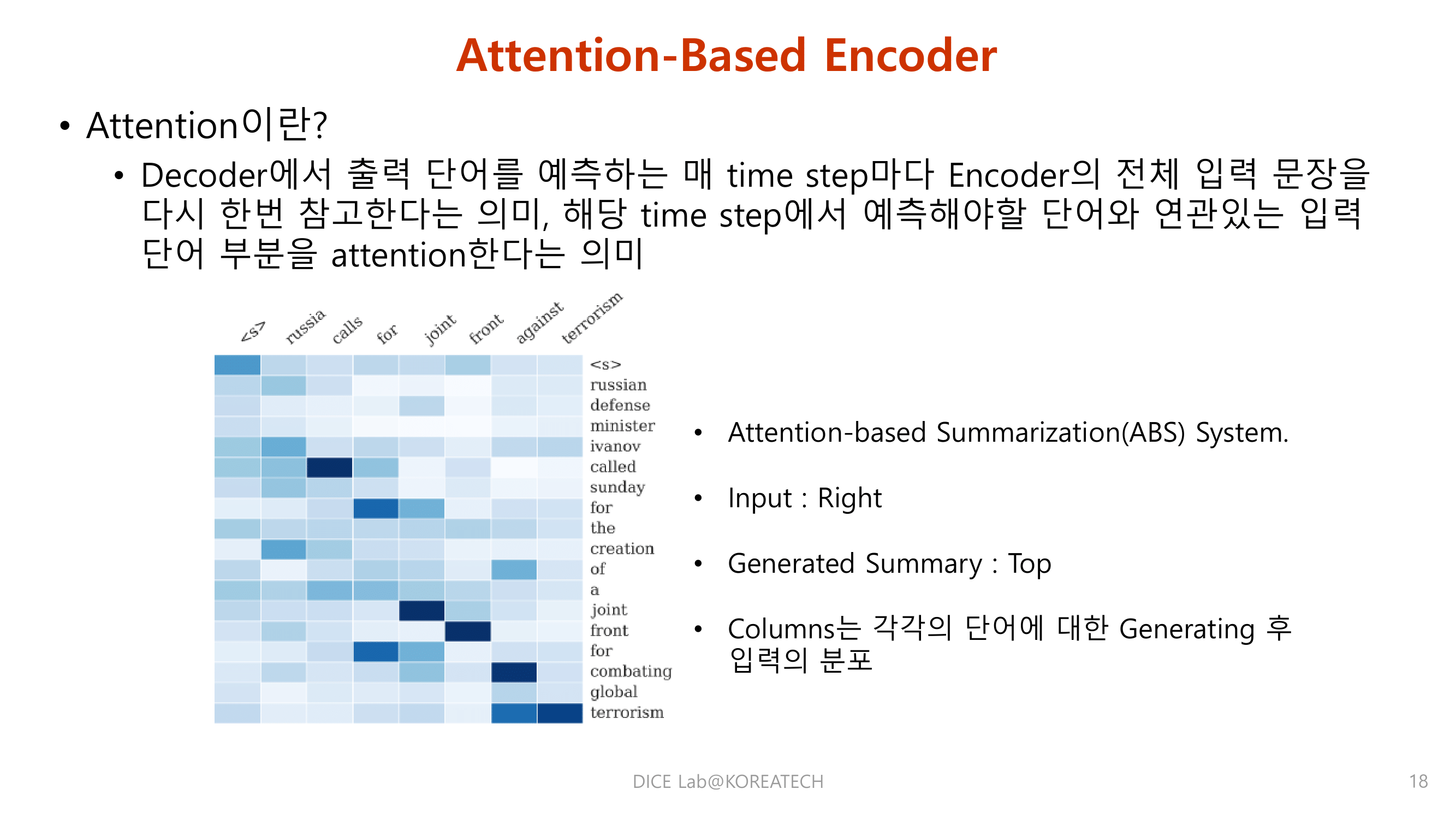

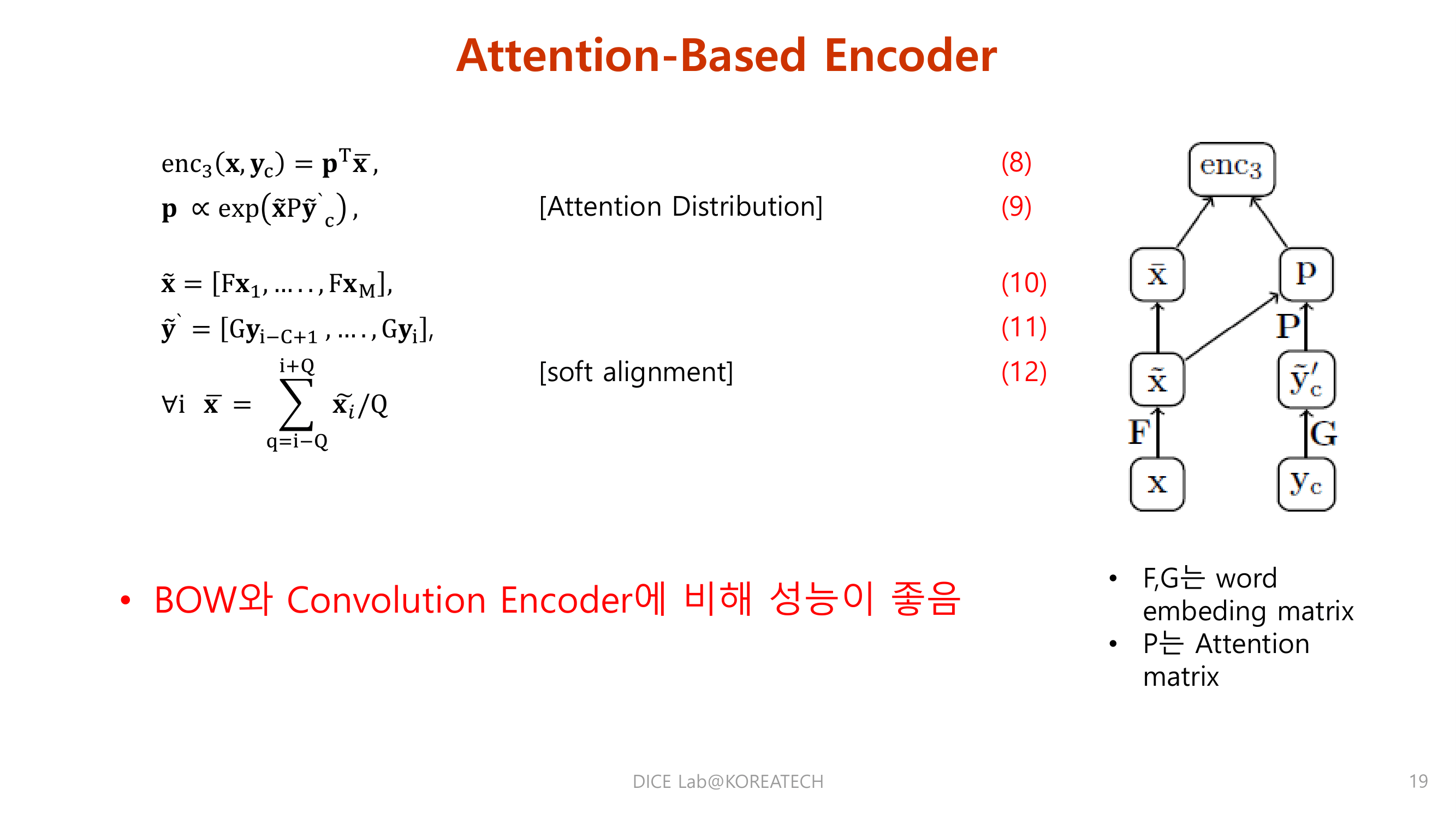

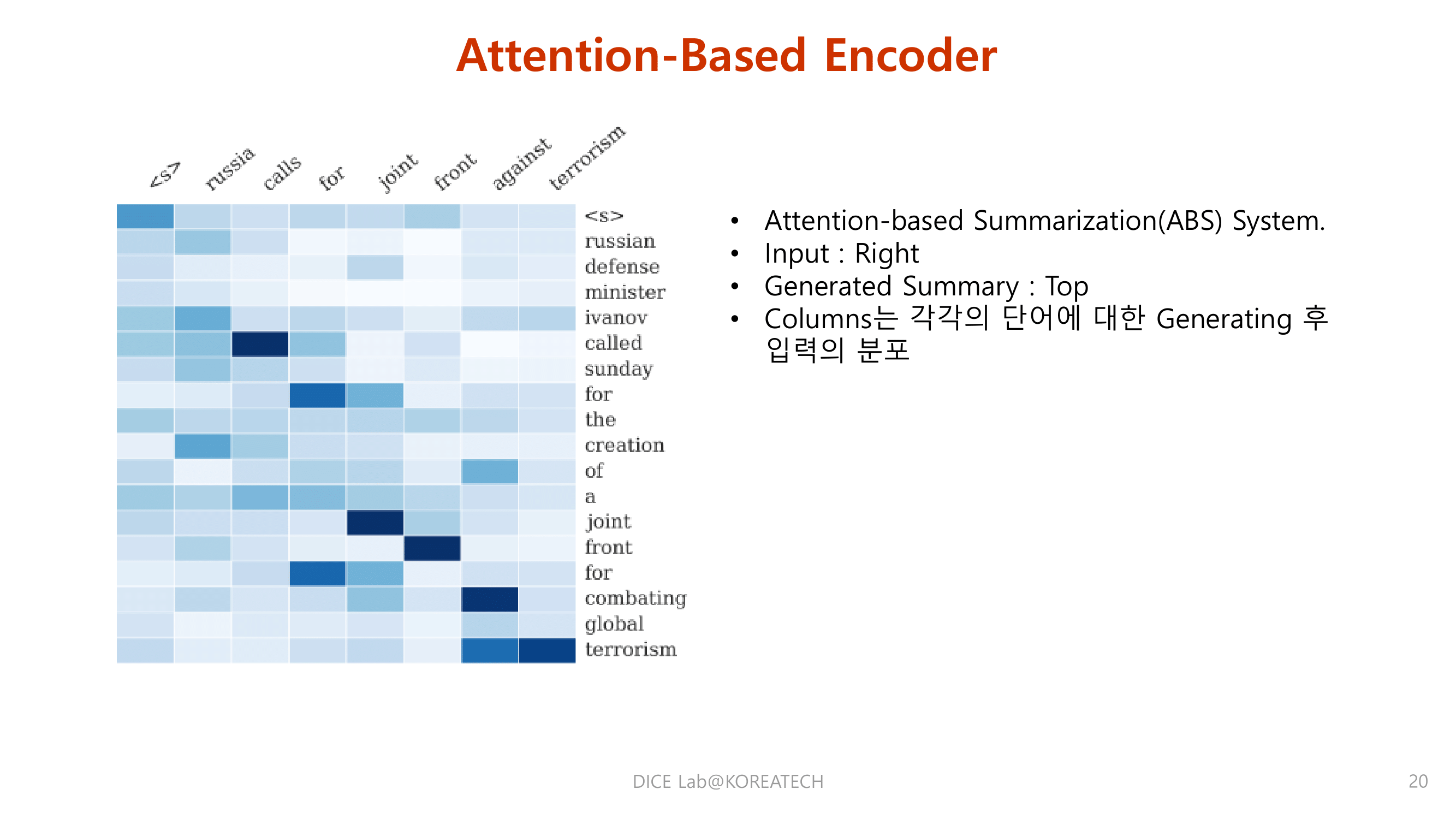

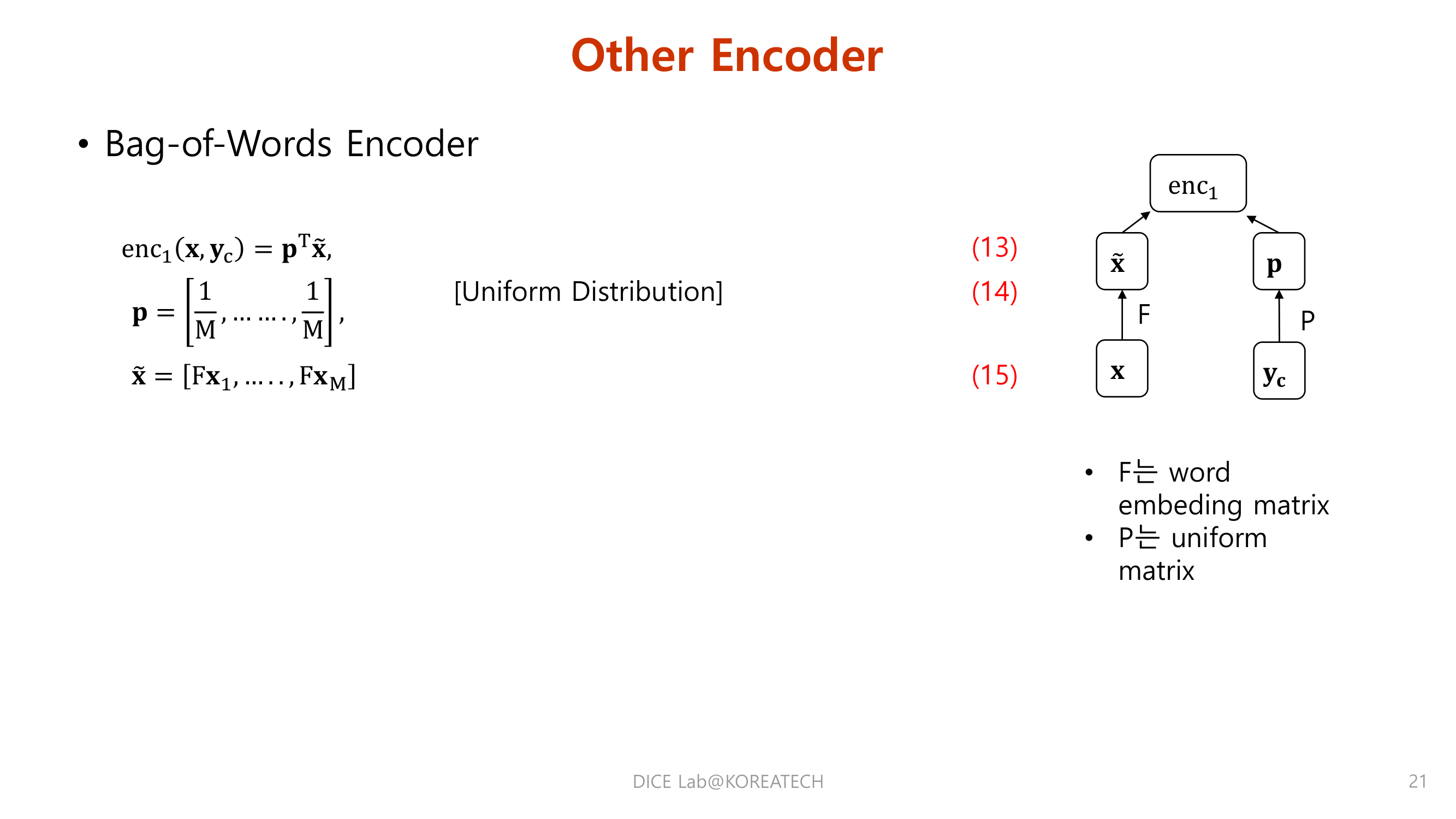

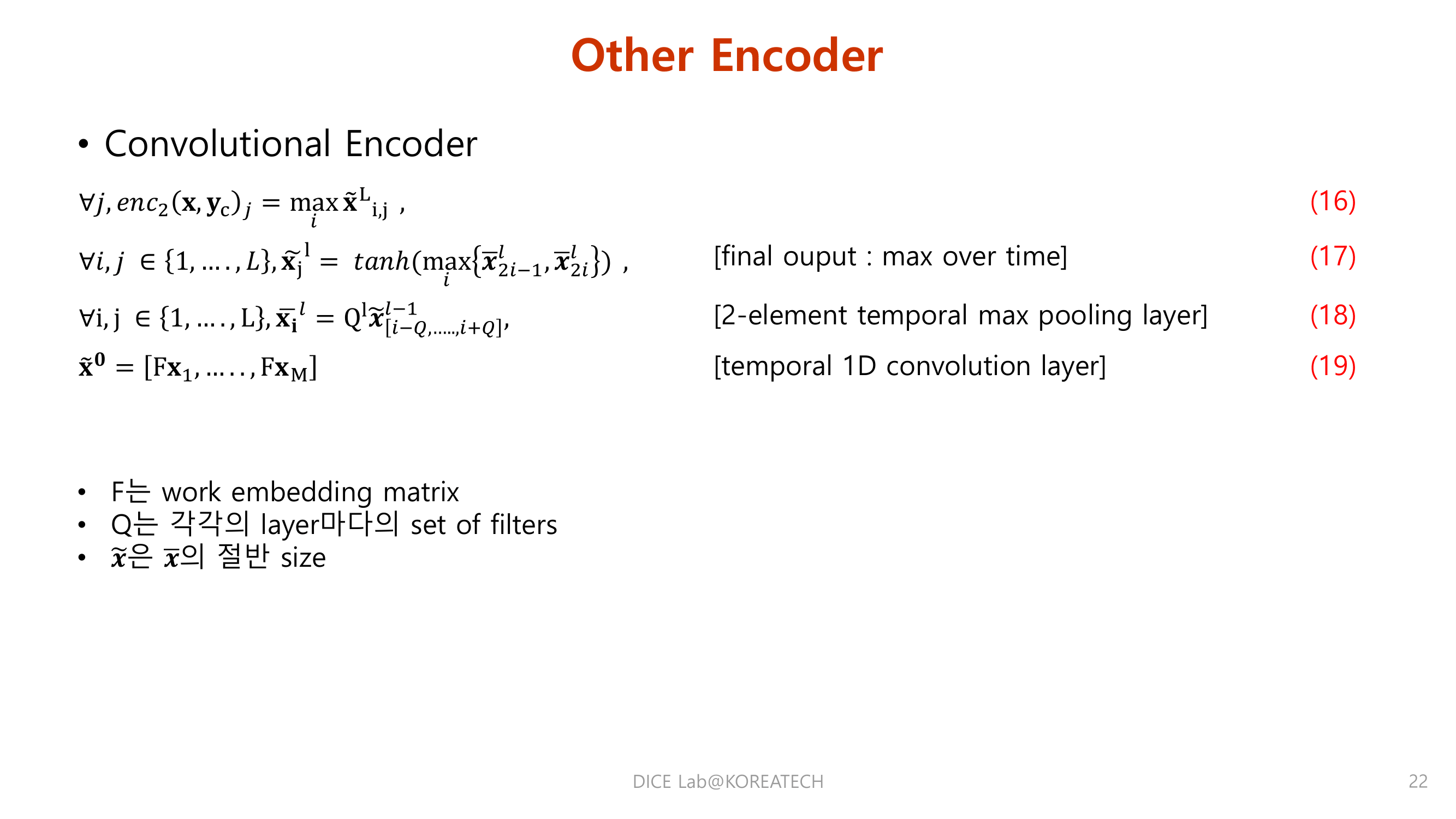

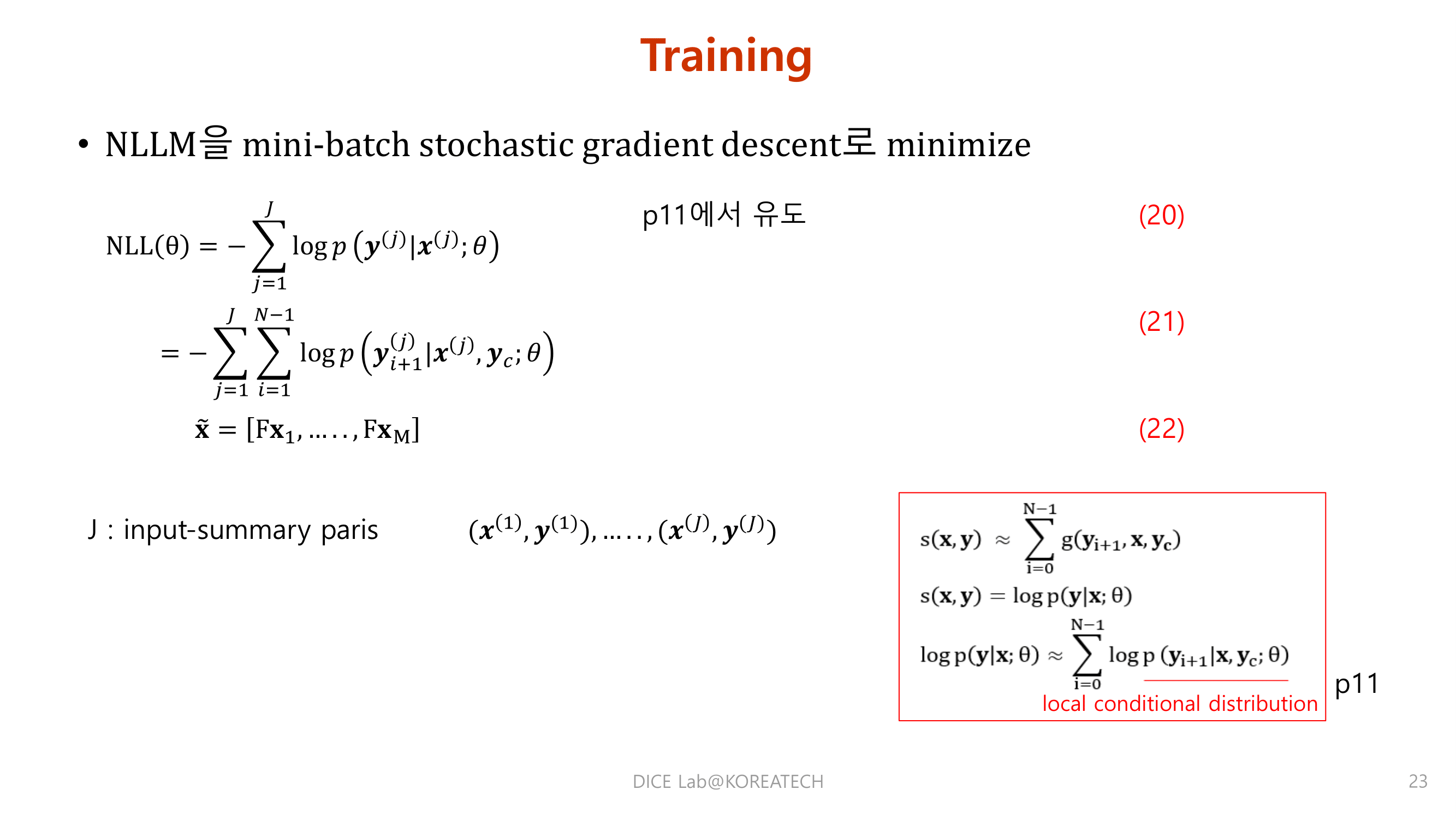

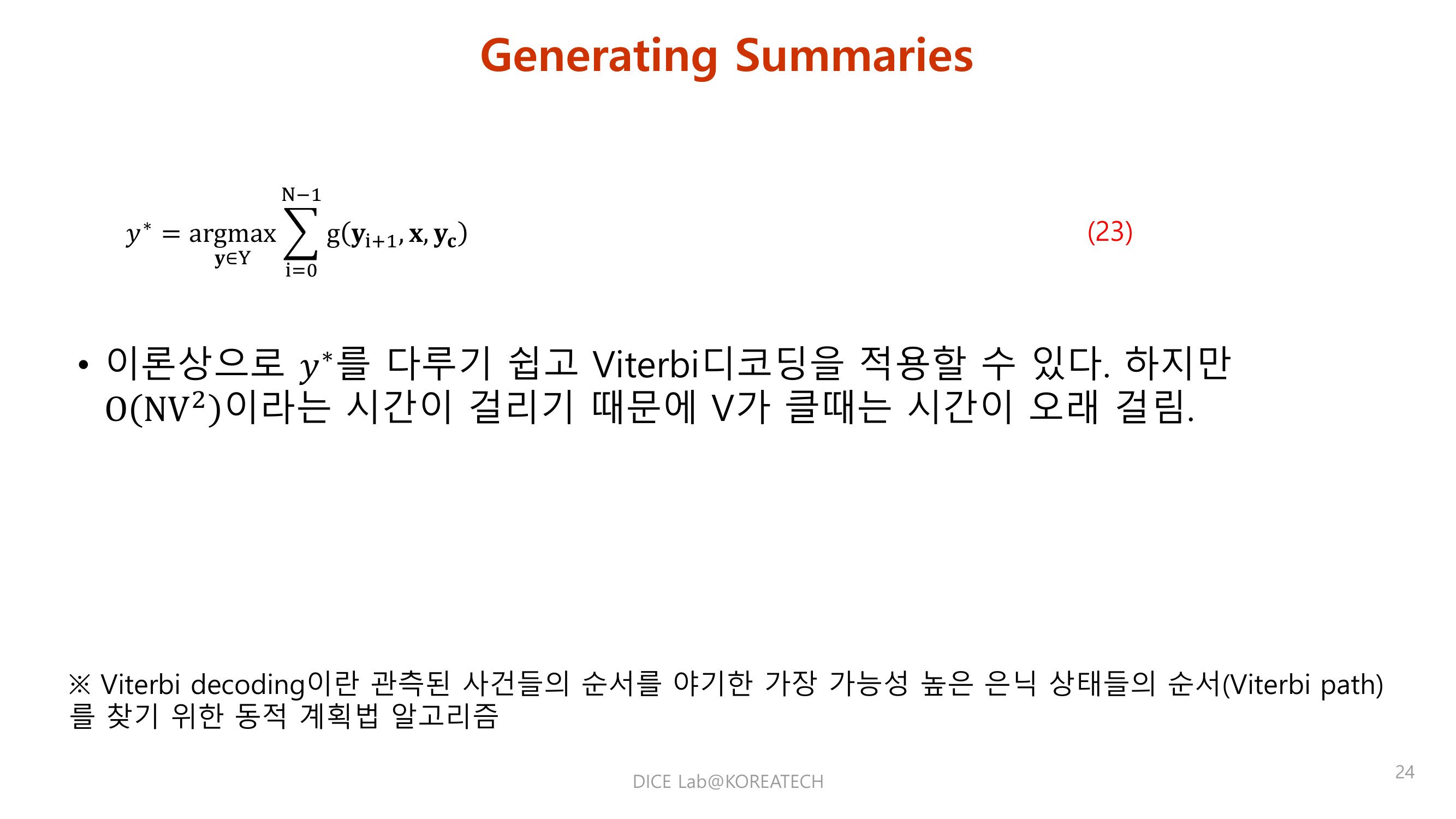

NNLM and Encoder

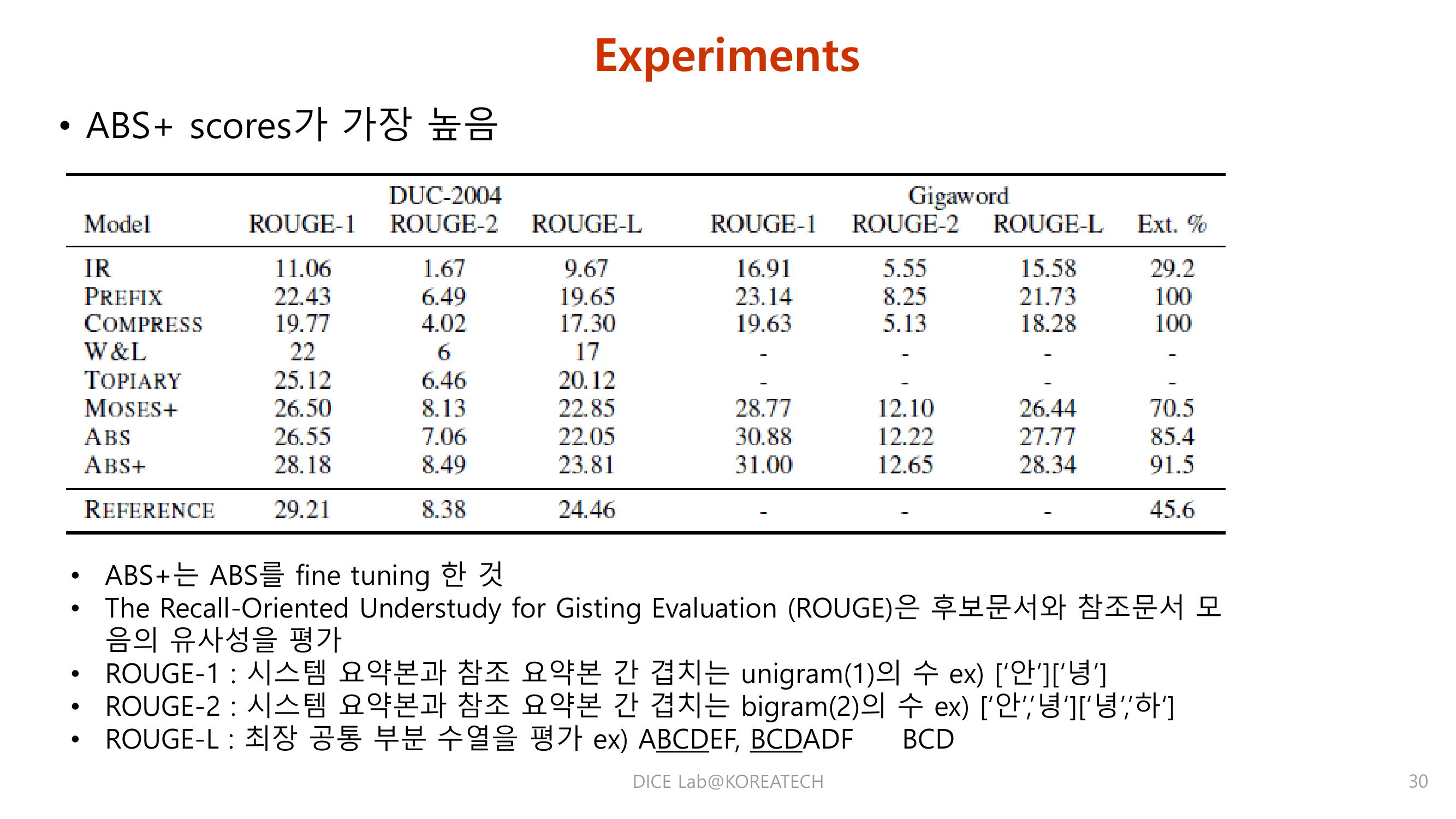

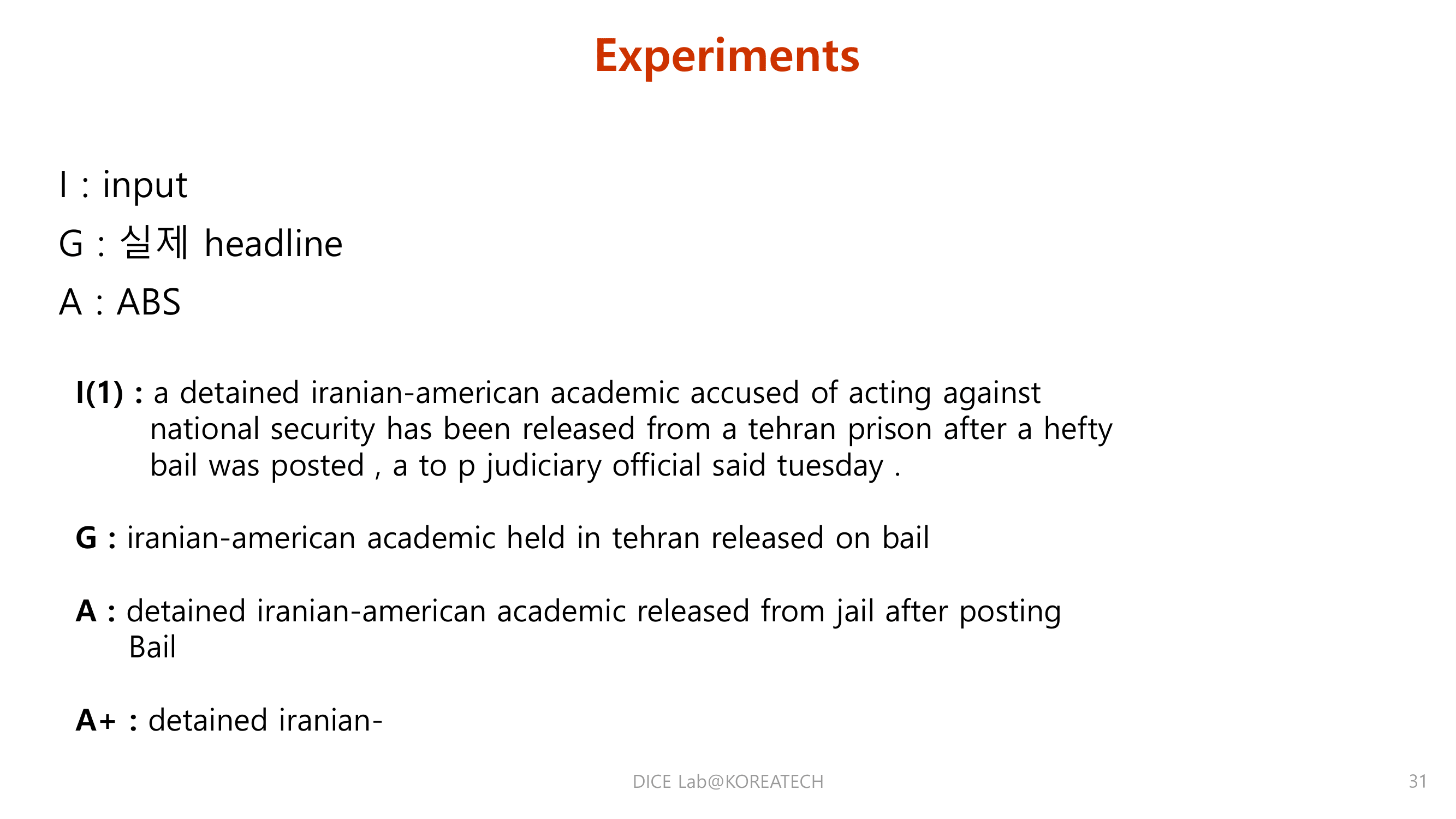

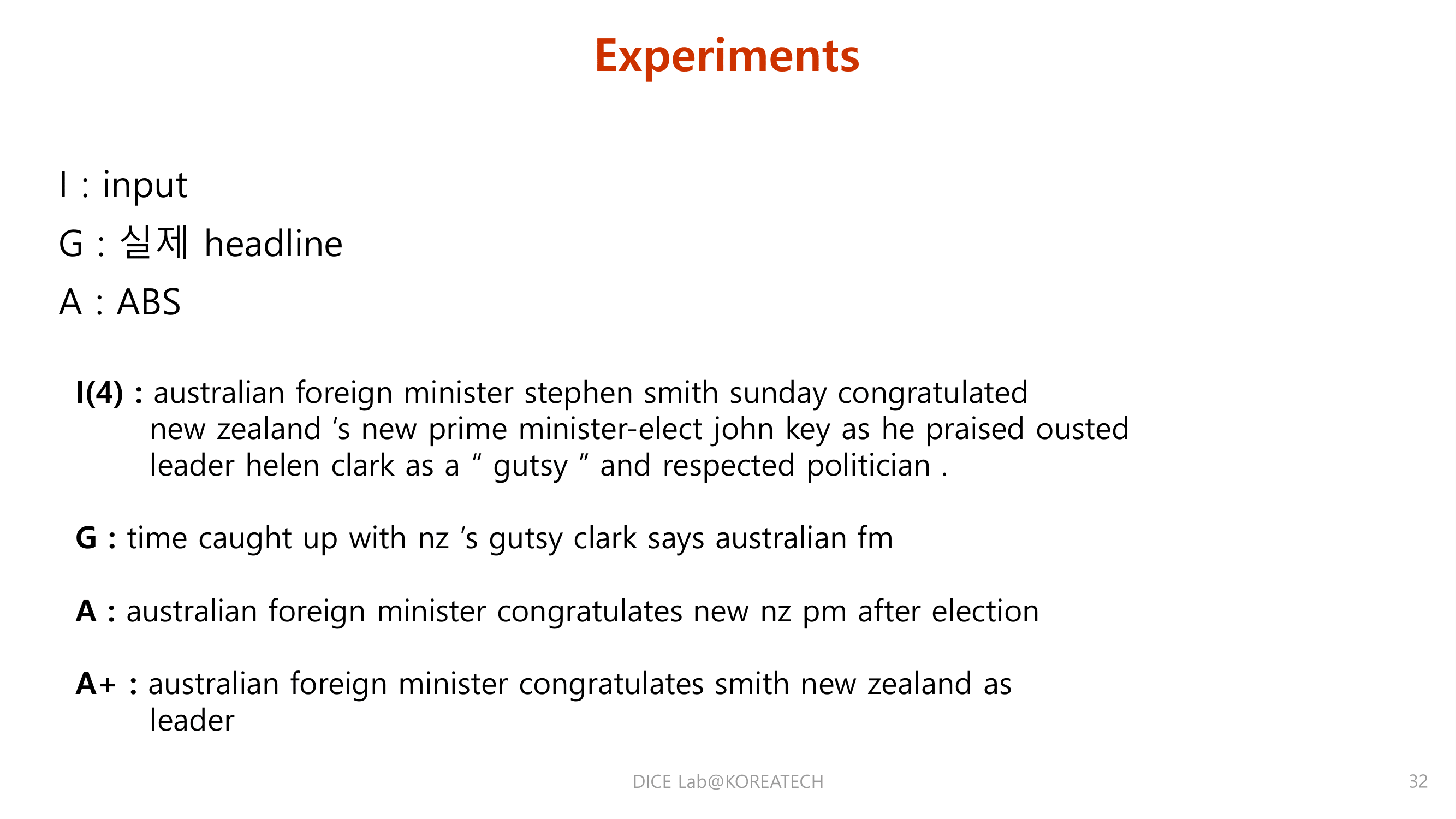

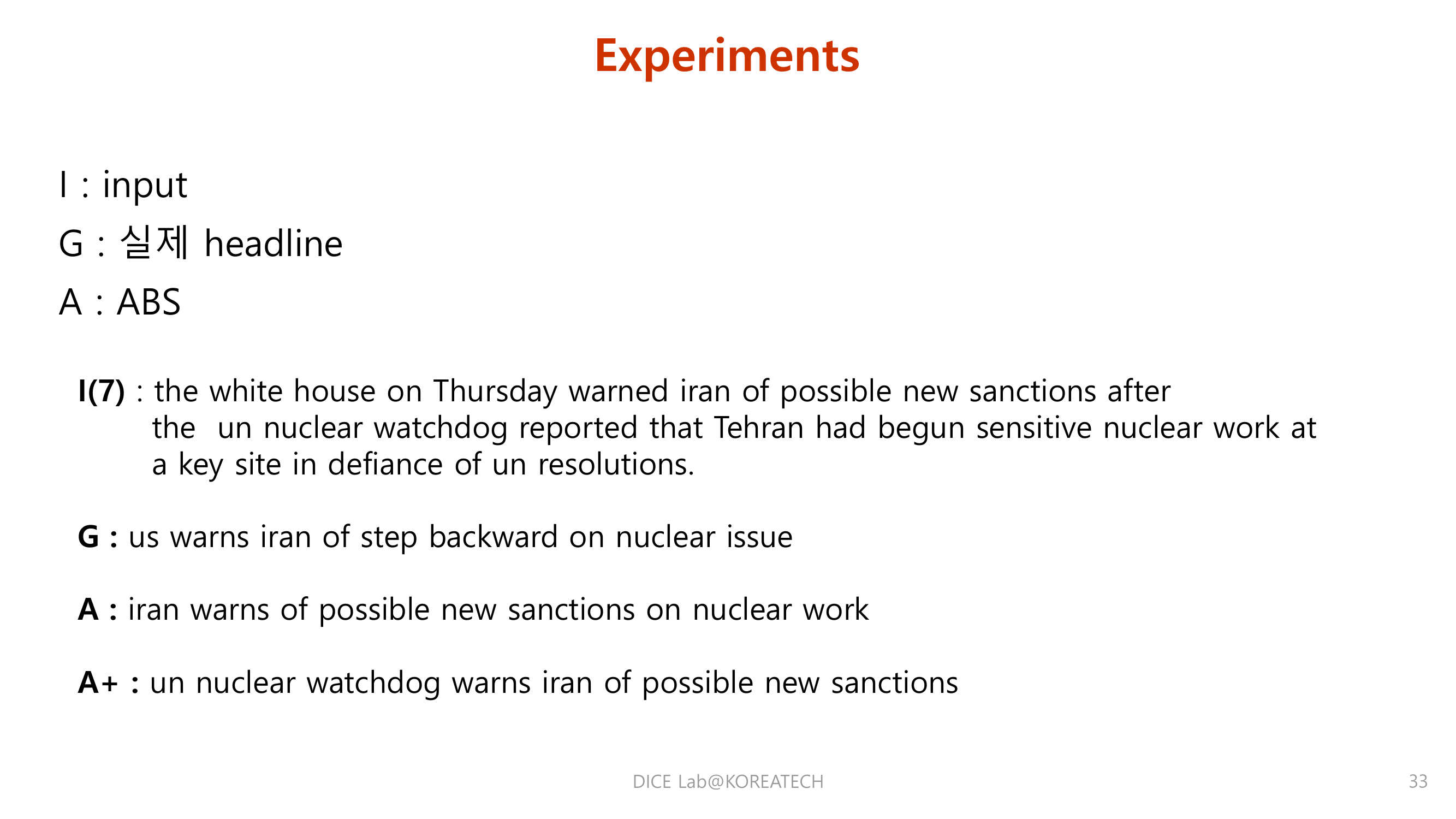

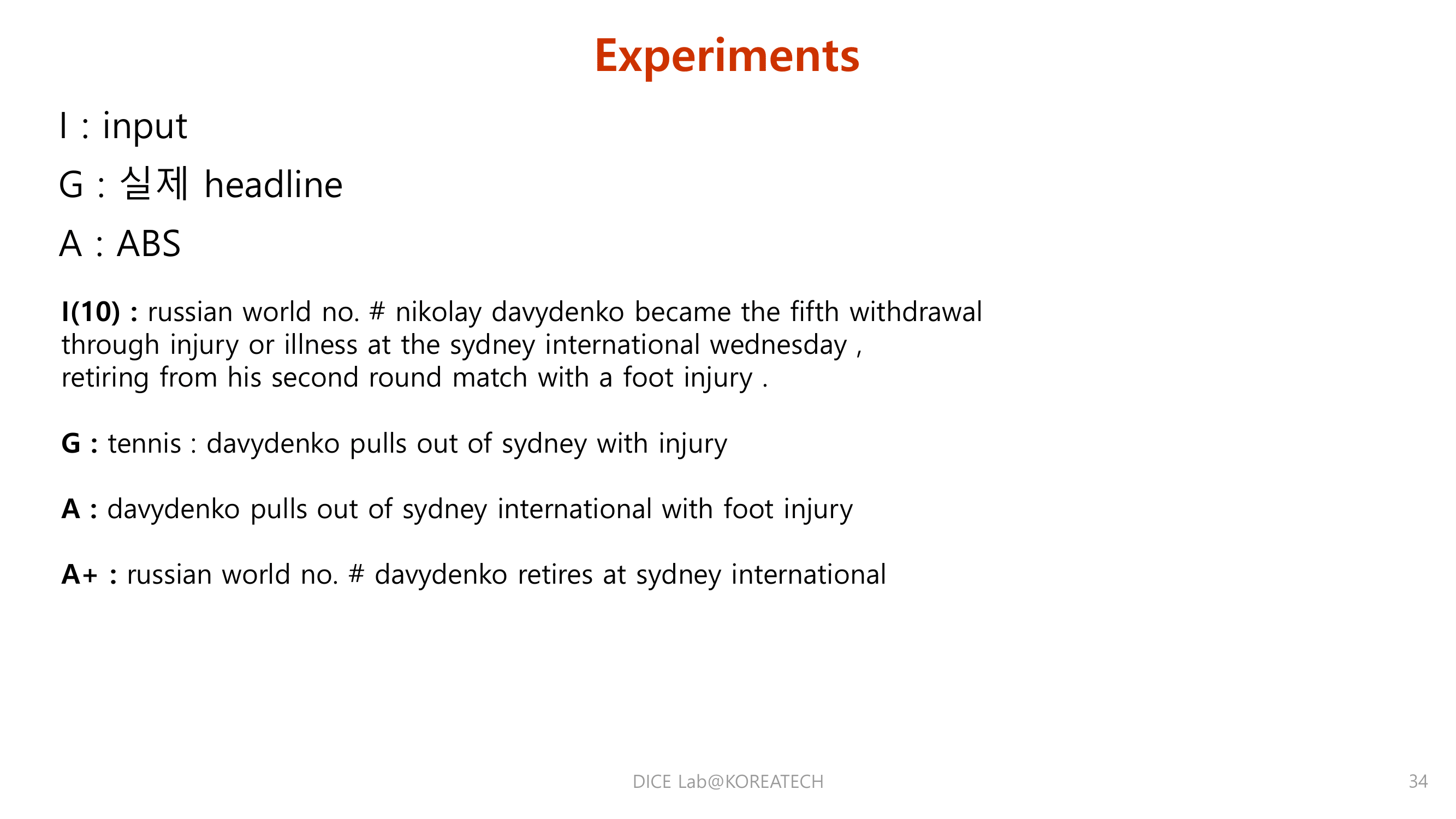

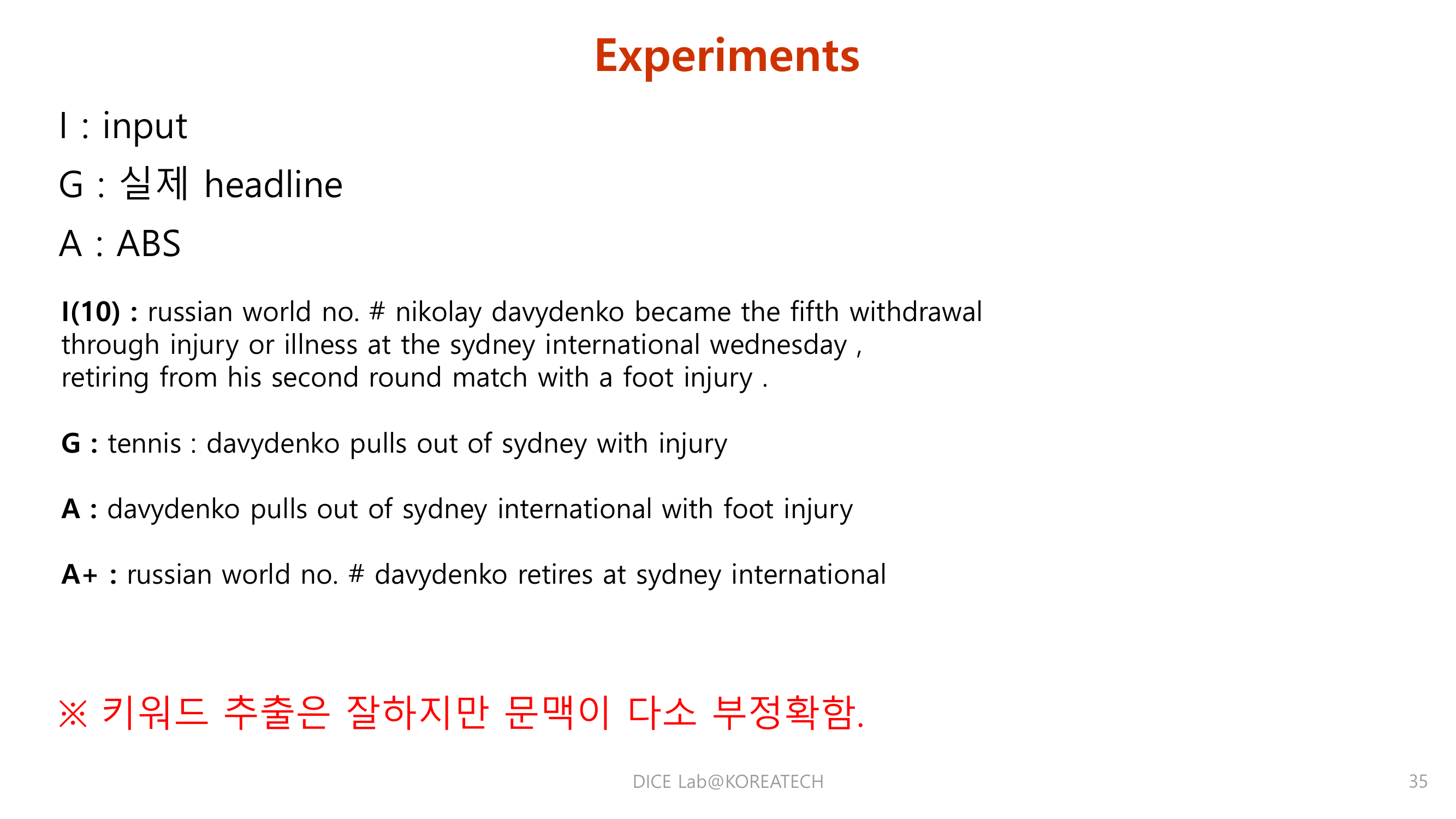

Experiments

Conclusions & Reviews

모델과 인코더가 단순한 구조지만 성능이 좋았다는 점이 흥미로웠다. 단순히 복잡한 모델만이 성능향상이 되는 것이 아닌 단순하고 효율적인 모델 구조를 가져야 한다는 점을 느꼈다.

실제로 생성한 Text가 문맥상 완벽하지 않다는 점을 보고 왜 Abstractive summlization가 어려운지를 느낄 수 있었다.

논문을 이해하는데 다소 어려움을 겪었기 때문에 현재 스터디하는 cs224s를 열심히 공부해 기본 지식을 탄탄히 가져가야겠다는 생각을 했다.

Reference

This post is licensed under CC BY 4.0 by the author.